nVidia GeForce 8800 GTX Review

Mit dem G80-Chip hat nVidia im November [3] wie bekannt den ersten Direct3D10-Grafikchip vorgestellt, welcher auch – wie seinerzeit nicht zu erwarten war – bis jetzt der einzige entsprechende Grafikchip im HighEnd-Segment ist. Zwar hat nVidia inzwischen entsprechende Modelle für das Mainstream-Segment nachgelegt [4], ATI hat sein G80-Konkurrenzprojekt bis jetzt nicht offiziell vorgestellt bzw. ausgeliefert. Damit ergibt sich die ungewöhnliche Situation, daß der G80-Chip nunmehr nach runden sechs Monaten im Markt immer noch völlig allein an der Leistungspitze steht.

Zwar biegt die ATI-Konkurrenz nun langsam wirklich auf die Zielgerade ein, steht aber für diesen Artikel noch nicht zur Verfügung, welcher sich primär also damit beschäftigen wird, wie sich die GeForce 8800 GTX als Top-Modell der G80-Varianten gegenüber den vorherigen HighEnd-Lösungen positionieren kann. Daß die GeForce 8800 GTX dabei gegenüber Radeon X1950 XTX und GeForce 7900 GTX mehr oder weniger problemlos überall vorn liegen sollte, wurde natürlich auch schon mit den allerersten Artikel zu dieser Karte schnell klar.

Allerdings basieren diese Erkenntnisse im Prinzip ausschließlich auf Messungen mittels Timedemos, welche aus mehreren Gründen als reichlich ungenau bezeichnet werden können. Genauere Hintergründe hierzu liefern entsprechende Artikel [5] hierzu, an dieser Stelle sei nur folgendes kurz ausgeführt: Bei Timedemo-Messungen fehlen im gewöhnlichen wichtige CPU-basierende Berechnungen wie die K.I. oder dynamische Physik- und Soundberechnungen. Dies ist nicht nur bei Prozessoren-Leistungstests störend, sondern betrifft auch Grafikkarten-Benchmarks, weil diese durch die abgesenkte CPU-Last teilweise deutlich höhere Frameraten als im realen Spiel auswerfen und damit auch eher in CPU-Limits laufen.

Hauptnachteil der Timedemo-Messungen ist aber, daß hiermit nur Durchschnittswerte von zumeist längeren Benchmark-Durchläufen ausgegeben werden (oder aber Minimalwerte von einzelnen Zehntelsekunden, was genauso nichtssagend ist). Damit läßt sich sicherlich ermitteln, welche Grafikkarte prinzipiell schneller ist – eine Aussage zur Spielbarkeit kann damit jedoch nicht getroffen werden. Man nimmt gewöhnlich an, daß ein Durchschnittswert von 40 fps ausreichend ist und damit auch die langsamen Szenen noch überhalb von 25 fps liegen sollten. Dies bleibt jedoch immer nur eine Annahme: Denn um zu einem Durchschnittswert von 40 fps zu kommen, kann das eine Spiel in der Tat zwischen 25 und 60 fps schwanken – ein anderes aber auch zwischen 10 und 100 fps.

Das Prinzip der Durchschnittsframeraten-Messungen wird diesem also selber zum Verhängnis, da bei einer solchen Messung eben nie festgestellt werden kann, wie die einzelnen Grafikkarten die wirklich Performance-kritischen Stellen bewältigen. Wenn man wirklich wissen will, wie es ausschaut, wenn die Frameraten nach unten gehen und die Hardware wirklich gefordert wird, muß auch auch nur genau das ausmessen – mittels kurzen Savegames von besonders performance-kritischen Stellen im Spiel. Erst mit diesen Messwerten in der Hand läßt sich dann auch sagen, welche Settings eine Grafikkarten noch verträgt – und welche nicht mehr.

Solcherart Benchmarks entsprechen damit auch dem, was der Spieler letztlich im Alltagseinsatz selber so macht: Die Orientierung der Spielsetting nicht an der (meist problemlosen) Durchschnittsperformance, sondern bewußt an den langsamen Stellen im Spiel. Kaum jemand stellt sein Spiel auf solcherart Settings, welche dem Spieler zwar gewöhnlich 40 garantieren, in bestimmten Szenen jedoch auf unter 15 fps einbrechen – in einer solchen Situation wird man wohl meistens seine Settings überdenken. Genau diesem Verhalten aus der Praxis sind auch unsere nachfolgenden Benchmarks geschuldet: Vermessen werden soll nicht eine Durchschnittsperformance, sondern das, was übrig bleibt wenn die Grafikkarten wirklich gefordert sind.

Dazu wurde wie gesagt auf Timedemo-Messungen verzichtet und komplett auf Savegames gesetzt. Jedes einzelne Savegame enthält dabei nur eine kurz Sequenz von drei bis fünf Sekunden mit einer wirklich Hardware-fordernden Spielszene, deren Durchschnittswerte mittels Fraps [6] (in jeweils drei Messungen) ermittelt wurden. Da zudem eine einzelne kurze Spielszene nur eine äußerst beschränkte Aussage zu den wirklichen Performance-Tiefstpunkten im Spiel geben kann, wurden für jedes Benchmark-Spiel gleich ganze vier Savegames angesetzt. Dieses Testverfahren ist insgesamt betrachtet äußerst aufwendig, erscheint uns aber derzeit als beste bekannte Möglichkeit, Grafikkarten nicht nur nach der Frage von "schneller oder langsamer", sondern auch nach der Frage "spielbar oder nicht spielbar" austesten zu können.

Vorab sei an dieser Stelle den Firmen Intel [7], nVidia [8] und Sapphire [9] für die unkomplizierte Stellung von Testsamples für unsere neuen Teststationen gedankt, womit auch dieser Artikel ermöglicht wurde. Ausdrücklicher Dank gilt zudem der Firma Asus [10] für die Teststellung der titelgebenden GeForce 8800 GTX.

Die Asus EN8800GTX/HTDP/768M

Wie der Einleitung zu entnehmen, haben wir für diesen Test die Asus-Ausführung der GeForce 8800 GTX namens "Asus EN8800GTX/HTDP/768M [12]" zu Rate gezogen. Hinter dieser verbirgt sich eine Standard-Ausführung der GeForce 8800 GTX, wenngleich Asus mit der "Asus EN8800GTX AquaTank/HTDP/768M [13]" inzwischen auch eine wassergekühlte und ab Werk ganz annehmbar übertaktete Sondervariante im Angebot führt.

Die Grafikkarten verfügt über zwei 6polige Stromstecker, entsprechende Kabel liegen der Karte allerdings bei. Daraus läßt sich auch schon die wichtigste Anforderung der Grafikkarte fürs PC-System ablesen: Das Netzteil muß eine gewisse Leistung mitbringen, um eine GeForce 8800 GTX stabil betreiben zu können. nVidia empfiehlt offiziell ein 450-Watt-Netzteil mit mindestens 30A auf der 12V-Leitung – was natürlich nur eine Richtlinie ist, ein gutes Netzteil kann die Karte eventuell trotz niedrigerer Spezifikationen stabil betreiben, ein weniger gutes benötigt eventuell viel höhere Spezifikationen. Auch hängt es natürlich davon ab, wieviele Geräte man noch so an der 12V-Leitung hängen hat.

Die hohen Netzteilanforderungen ergeben sich natürlich aus der hohen Stromaufnahme der GeForce 8800 GTX, welche von den X-bit Labs [15] auf 132 Watt im 3D-Betrieb ausgemessen wurden. Während dieser Wert angesichts die Performance der GeForce 8800 GTX noch als gangbar erscheint, sind die 70 Watt Stromverbrauch im Idle-Zustand eigentlich indiskutabel. nVidia arbeitet diesbezüglich angeblich an einem Treiber, welcher diesen 2D-Stromverbrauch deutlich senken soll, bisher hat sich allerdings an dieser Front noch nichts getan. Damit verbrauchte unser Testsystem samt GeForce 8800 GTX unter 2D weiterhin so viel Strom wie ein dasselbe Testsystem samt GeForce 7900 GTX unter 3D-Last:

| Stromverbrauch Windows-Desktop | Stromverbrauch Spiel | |

|---|---|---|

| Testsystem + Radeon X1950 XTX | 169 Watt | 279 Watt |

| Testsystem + GeForce 7900 GTX | 172 Watt | 226 Watt |

| Testsystem + GeForce 8800 GTX | 228 Watt | 320 Watt |

Trotz dieser also recht hohen Stromaufnahmen gerade unter 2D arbeitet der verbaute Lüfter anständig leise: Im 2D-Betrieb dreht der Lüfter auf geringeren Umdrehungen und ist selbst beim offenen Aufbau der Teststation nicht wirklich wahrnehmbar. Unter 3D-Last dreht der Lüfter dagegen etwas auf, bleibt aber dennoch immer noch bei einem gewissen "Hintergrund-Rauschen" und dürfte somit den Spieler eigentlich nirgendwo stören. Diesbezüglich haben Asus und nVidia eine gute Arbeit abgeliefert, die GeForce 8800 GTX liegt somit bei der Geräuschbelastung trotz höherer Stromaufnahme noch klar vor der (nicht als besonders leise bekannten) Radeon X1950 XTX.

Die Testkandidaten im Vergleich

Da ATIs erster HighEnd-Grafikchip für das HighEnd-Segment R600 erst im Laufe des Mai zu erwarten ist, stehen für diesen Test als G80-Counterparts nur die "alten" HighEnd-Lösungen G71 (in Form der GeForce 7900 GTX) und R580 (in Form der Radeon X1900 XTX und Radeon X1950 XTX) zur Verfügung. Natürlich sollte damit klar sein, daß diese auch schon rein technisch der dem G80-Chip in Form der GeForce 8800 GTX nicht das Wasser reichen können:

| ATI Radeon X1950 XTX | nVidia GeForce 7900 GTX | nVidia GeForce 8800 GTX | |

|---|---|---|---|

| Chip-Basis | ATI R580+, 384 Millionen Transistoren in 90nm bei TSMC | nVidia G71, 278 Millionen Transistoren in 90nm bei TSMC | nVidia G80, 681 Millionen Transistoren in 90nm bei TSMC |

| Technologie-Klasse | DirectX 9.0c, Shader Model 3.0 | Direct3D10, Shader Model 4, unified Shader Architektur | |

| grundlegende Technik | 16 Rendering-Pipelines mit jeweils drei Pixelshader-Einheiten (insgesamt 48 Pixelshader-Einheiten), dazu 8 Vertexshader-Einheiten, 16 ROPs, 256 Bit DDR Speicherinterface (8x32 Bit) | 24 Rendering-Pipelines mit jeweils einer Pixelshader-Einheit (insgesamt 24 Pixelshader-Einheiten), dazu 8 Vertexshader-Einheiten, 16 ROPs, 256 Bit DDR Speicherinterface (4x64 Bit) | 128 Shader-Einheiten, 32 Textureneinheiten, 24 ROPs, 384 Bit DDR Speicherinterface (6x64 Bit) |

| Taktraten | 650/1000 MHz | 650/800 MHz Vertexshader: 690 MHz |

575/900 MHz Shader-Einheiten: 1350 MHz |

| Bauform | 512 MB GDDR4, PCI Express, DualSlot, vollständig HDCP-kompatibel | 512 MB GDDR3, PCI Express, DualSlot, vollständig HDCP-kompatibel | 768 MB GDDR3, PCI Express, DualSlot, vollständig HDCP-kompatibel |

| Stromverbrauch laut den X-bit labs (Idle/2D/3D) | 33/54/125 Watt | 31/52/84 Watt | 70/83/132 Watt |

| ähnliche, nur im Takt unterschiedliche Karten | Radeon X1900 XTX 512MB mit 650/775 MHz, Radeon X1950 XT 512MB mit 625/800 MHz, Radeon X1900 XT 512MB mit 625/750 MHz | GeForce 7950 GT 512MB mit 550/700 MHz, GeForce 7900 GT 512MB mit 450/660 MHz | - |

Wie schon öfters auf diesen Seiten erwähnt, lassen sich diese drei unterschiedlichen Architekturen kaum anhand der Anzahl an Shader-Einheiten oder TMUs vergleichen – hierfür gibt es schließlich "echte" Performance-Vergleiche. Obige Tabelle steht nur der Vollständigkeit halber in diesem Artikel – und um zu verdeutlichen, welche vergleichbaren Karten es zu jeder der Testkandidaten gibt.

Gerade bei der Radeon X1950 XTX ist dies recht interessant, da es hier in Form von Radeon X1900 XT, Radeon X1950 XT und Radeon X1900 XTX gleich drei weitere Karten mit denselben technischen Daten und immer noch als ähnlich anzusehenden Taktraten gibt, deren Performance also nur geringfügig unter den Werten der Radeon X1950 XTX selber liegt. Ein Vergleich speziell der früheren ATI HighEnd-Lösungen Radeon X1900 XTX gegen Radeon X1950 XTX findet sich zudem am Ende dieses Artikels.

Bei der GeForce 7900 GTX bieten sich hingegen zwei Karten mit denselben technischen Daten an, allerdings sind hier die Taktraten zumindestens bei der GeForce 7900 GT schon erheblich abweichend. Allerdings kann zumindestens die GeForce 7950 GT den Anspruch erheben, nicht wesentlich hinter der GeForce 7900 GTX zu liegen. Nur zur GeForce 8800 GTX gibt es derzeit keine Karten mit denselben technischen Daten – die nächstkleinere Variante GeForce 8800 GTS hat einige technische Abspeckungen und liegt in der Performance im gewöhnlichen 30 Prozent und mehr hinter der GeForce 8800 GTX zurück.

Technikvergleich Anti-Aliasing

Vor den eigentlichen Benchmarks wollen wir uns zuerst mit Anti-Aliasing und anisotropen Filter der beiden großen Grafikchip-Entwickler beschäftigen – bzw. in erster Linie, wie gut diese überhaupt miteinander vergleichbar sind. Denn natürlich sind Vergleich rein anhand des Namens nicht wirklich seriös – ein "4xAF" bei dem einem Hersteller kann bei einem anderen Hersteller etwas ganz anderes bedeuten, schließlich gibt es diesbezüglich keine für alle Hersteller verbindliche Namenskonvention. Vor einem Leistungsvergleich steht daher erst einmal der Optikvergleich, um zu sehen, was man da überhaupt gegeneinander ausmisst.

Verhältnismäßig einfach haben wir es diesbezüglich beim Punkt Anti-Aliasing. Dies hängt zum einen damit zusammen, daß es hier keine der "allseits beliebten" Optimierungen gibt – und zum anderen, weil der G80-Chip zwar auch hier einige Neuerungen mit sich bringt, gerade bei den kleineren Modi jedoch weiterhin dem entspricht, was schon frühere Grafikchips von nVidia konnten.

Dazu aber später mehr, erst einmal ein kurzer Abriß der bezüglich ATI und nVidia gebotenen "normalen" Anti-Aliasing Möglichkeiten. Anzumerken wäre, daß wir uns bei der Filterqualität rein auf den unter Direct3D laufenden FSAA Tester [16] verlassen haben, da bei beiden Grafikchip-Entwicklern unter den normalen Anti-Aliasing Modi keine Unterschiede mehr zwischen Direct3D und OpenGL existieren:

Gleiches nun für nVidias GeForce7-Serie, wobei hier der 2x Quincunx Modus herausgelassen wurde, da dieser nicht der eigentlichen Definition von Anti-Aliasing entspricht, sondern eher ein Weichzeichner ist (mit welchem vornehmlich Texturinformationen weichgezeichnet und damit zerstört werden):

Und letztlich kommt nun noch der G80-Chip an die Reihe, welcher einige neue Anti-Aliasing Modi mitbringt:

Wie zu sehen, hat nVidia oberhalb des 4x Modus einiges geändert: Sämtliche Hybrid-Modi zwischen Multisampling und Supersampling Anti-Aliasing sind beim G80-Chip nicht mehr mit dabei, dafür gibt es nunmehr ein vollwertiges 8x sparsed Grid Multisampling Anti-Aliasing, welches in der Kantenglättungsqualität ATIs 6x Lösung sogar minimal überflügeln kann (sehr viel besser kann es nicht werden, weil mit steigender Samplingzahl die jeweiligen Bildqualitätsgewinne relativ gesehen deutlich geringer werden).

Zudem gibt es ein neuartiges "Coverage Anti-Aliasing", welches mit nur einem geringen (relativen) Leistungsverlust auch hohe Anti-Aliasing Modi ermöglichen soll. Dazu benutzt der nVidia-Treiber bei den Coverage Anti-Aliasing Modi eine geringere Anzahl an Farb- und Z-Werten als normalerweise, womit in erster Linie Speicherbandbreite gespart wird, was bei hohen Anti-Aliasing Modi im gewöhnlichen der größte Bremsklotz ist. In der Summe kommt Coverage Anti-Aliasing damit mit einem Bruchteil der Leistungsanforderungen aus, als wenn man dieselbe Sampleanzahl in einem reinem Multisampling berechnen wollte.

Dafür funktioniert Coverage Anti-Aliasing allerdings nicht in jeder Anwendung – so beispielsweise nicht mit den in F.E.A.R. benutzten Stencil-Schatten. Positiverweise fällt in einem solchen Fall nicht gleich das komplette Anti-Aliasing aus, sondern vielmehr wird immer noch der gewöhnliche Multisampling-Teil dargestellt, welchen die Coverage Anti-Aliasing Modi immer mit enthalten. Allerdings muß auch gesagt werden, das gerade überhalb des schon ziemlich perfekten 8x Anti-Aliasings der GeForce8-Serie die Luft dann schon sehr dünn wird für weitere Qualitätsverbesserungen. Wirklich großartige Unterschiede der 16x Modi zeigen unsere Screenshots nicht, hier muß man dann wohl mit 32x oder besser gleich 64x Anti-Aliasing ankommen, um noch eine wirklich merkbare Verbesserung zu erreichen.

Davon abgesehen unterstützen die getesteten Grafikkarten-Serien beider Grafikchip-Entwickler nun auch noch Anti-Aliasing auf transparente Texturen, bei nVidia "Transparenz Anti-Aliasing" (TAA) und bei ATI "Adaptive Anti-Aliasing" (AAA) genannt. Dieses Transparenz Anti-Aliasing (wir verwenden nachfolgend allgemein den nVidia-Begriff, da dieser die Sache klarer beschreibt) kümmert sich um diese Lücken, welche Multisampling Anti-Aliasing läßt: Da dieses nur an echten Kanten glättet, werden Kanten, die nur innerhalb von Texturen liegen, von Multisampling Anti-Aliasing nicht mit erfasst und somit nicht geglättet.

Dabei ist die Nutzung von Texturen, welche Objektkanten innerhalb der Textur selber enthalten, gar nicht einmal so selten: So baut kaum ein Spielentwickler ein einfaches Geländer geometrisch korrekt aus Einzelelementen auf – dies würde die nötige Arbeit nur potenzieren und die Leistungsanforderungen für die aufwendigere Szenengeometrie in die Höhe schieben. Der Einfachheit halber bedient man sich einfach einer Geländer-Textur, in welcher die Elemente des Geländers eingezeichnet sind und die restlichen Stellen als transparent definiert sind, um im realen Spiel dann die dahinterliegenden Objekte sehen zu können. Nachteiligerweise kann Multisampling Anti-Aliasing dies natürlich nicht glätten, weil es die Kanten, die innerhalb der Textur selber liegen, nicht erkennen kann.

Hier kommt nun Transparenz Anti-Aliasing ins Spiel, welches immer dann, wenn transparente Texturen verwendet werden, diese mit einem zusätzlichen Anti-Aliasing für die Textur selber überzieht. Zumeist verwendet man dabei ein 4x Supersampling (nVidia hat auch einen zusätzlichen TAA-Modus mit 4x Multisampling im Angebot, welcher jedoch keine besondere Wirkung hat), welches wie gesagt nur für die transparente Textur selber zum Einsatz kommt, nicht für das gesamte Bild. Welches enormen Effekt dieses Transparenz Anti-Aliasing entfalten kann, sei an nachfolgendem Screenshot aus Half-Life 2 demonstriert (MouseOver-Effekt per Javascript, Alternativ-Variante: Klick öffnet beide Screenshots im unkomprimierten Großformat):

Gerade mit diesem Screenshot-Vergleich sollte deutlich werden, wie enorm die Wirkung von Transparenz Anti-Aliasing sein kann – was uns wiederum dazu führt, welche Bedeutung man diesem Feature inzwischen einräumen sollte. Gerade in der heutigen Zeit, wo die Augen des Anwenders von sauber kantengeglätteten Objekten verwöhnt sind, fallen schließlich jene Strukturen, welche sich Multisampling Anti-Aliasing bisher hartnäckig zur Wehr gesetzt haben, um so stärker auf – und sollten demzufolge um so energischer bekämpft werden.

Demzufolge ist die Hinzunahme von TAA bei nVidia und AAA bei ATI zur Featurepalette der jeweils aktuellen Grafikchip-Generation nur zu begrüßen. Offiziell ist ATIs Adaptive Anti-Aliasing, einstmals allein für die Radeon X1x00 Serie angekündigt, inzwischen ja auch bei allen ATI-Grafikchips seit der Radeon 9500/9700 Serie verfügbar. Auf nVidia-Seite scheint sich derzeit ähnliches anzubahnen: Offiziell ist nVidias Transparenz Anti-Aliasing bisher nur für die GeForce7-Serie verfügbar, ein neuer Beta-Treiber [34] ermöglicht das Feature allerdings nun auch bei den Grafikkarten der GeForce6-Serie.

Und letztlich wäre zum Thema Anti-Aliasing noch zu erwähnen, daß nVidia mit der GeForce8-Serie einen alten Nachteil der bisherigen nVidia-Grafikchips beseitigt hat, welche im gewöhnlichen kein Anti-Aliasing unter HDR-Rendering boten. Die GeForce8-Serie ist nunmehr dazu in der Lage und zieht diesbezüglich nun mit den ATI-Karten gleichauf.

Technikvergleich anisotroper Filter

Nach der Betrachtung der Möglichkeiten von ATI und nVidia beim Thema Anti-Aliasing folgt nun selbiges zum Thema des anisotropen Filters – welches mit dem grundsätzlichen Unterschied gewürzt ist, daß man hierzu eigentlich ganze Bücher an Material füllen könnte. Denn hier spielen nun neben unterschiedlichen Settings und Wertigkeiten nun auch noch die beliebten Filter-"Optimierungen" mit hinein, steigt die Komplexität eines Vergleichs also enorm an, wollte man alle diese Optionen berücksichtigen.

Deshalb haben wir uns dazu entschloßen, nur noch die wichtigsten und am häufigsten genutzten Optionen anzusprechen – letztlich geht es schließlich immer darum, was in der Praxis mehrheitlich passiert und nicht, was rein theoretisch alles möglich wäre. Demzufolge enthält die nachfolgende tabellarische Aufstellung nunmehr auch nur Screenshots von 4x und 16x anisotropen Filter: Das 4x, weil hierbei die verschiedenen Ansätze noch am besten zu sehen sind, und das 16x, weil bei diesem die teilweise arg geringen Unterschiede zwischen den niedrigen und den hohen AF-Modi gut zur Geltung kommen.

Gleichfalls beschäftigt sich die nachfolgende Aufstellung auch nur noch mit dem anisotropen Filter per Aktivierung aus der

Anwendungssoftware (dem Spiel) heraus, nicht mehr mit dem anisotropen Filter per Aktivierung aus dem Control Panel des Herstellers. Dies hat vor allem früher noch sehr unterschiedliche Filterqualitäten ergeben, da bei Aktivierung aus dem Spiel heraus zumeist keine Filter-"Optimierungen" angesetzt wurden, bei Aktivierung per Control Panel dafür um so mehr. Da aber inzwischen die allermeisten der heutigen Spiele eigene Optionen für den anisotropen Filter mit bringen, haben wir uns rein auf diese Variante konzentriert.

Und letztlich haben wir uns nachfolgend bei der Darstellung der herauskommenden Filterqualität wieder allein auf Direct3D und dort das Tool D3D AF-Tester [35] verlassen, da OpenGL heutzutage im Spiel-gesteuerten Modus keine Unterschiede mehr zeigt. Und damit zu den Möglichkeiten von ATI, wobei wir hier nur den Standard-Modus sowie das zuschaltbare Area-AF berücksichtigen, den von der Bildqualität her schwächeren Modus "Advanced" sowie das in der Praxis eher nutzlose "A.I. off" ergo nicht betrachten werden:

Sehr deutlich wird erst einmal im Vergleich von 4x zu 16xAF im Standard-Modus, wie wenig Gewinn an Bildqualität man damit doch erhält – und obwohl es sich immerhin um einen Sprung von zwei Stufen handelt. Die ab 4xAF allerdings einsetzende Winkelabhängigkeit verhindert jedoch effektiv, daß man unter 8x bzw. 16xAF all zu häufig mit 8x oder 16x gefiltere Texturen zu Gesicht bekommt. Zudem hat Winkelabhängigkeit auch immer den Nachteil, daß sie je nach Spielsituation in direkt nebeneinanderliegenden unterschiedlich stark gefilterten Texturen resultieren kann, was dann deutlich den optischen Eindruck stört.

Insofern ist ATIs Entscheidung, der Radeon X1x00 Serie eine (fast) winkelunabhängige anisotrope Filterung zu spendieren, nur ausdrücklich zu begrüssen – und der Effekt ist mit obigen Screenshots auch eindrucksvoll belegt. nVidia hat hier mittels der GeForce8-Serie inzwischen nachgelegt, für die GeForce7-Serie wird jedoch noch kein winkelabhängiger anisotroper Filter mehr verfügbar werden. Nachfolgend sei daher der Standard-Modus "Quality" sowie der bessere Modus "High Quality" aufgezeigt, die beiden von der Bildqualität her schwächeren Modi "Performance" und "High Performance" werden wir dagegen nicht betrachten:

Auf den ersten Blick wird hier schon klar, daß nVidias default-Modus bei der G7x-Serie nicht mit ATIs default-Modus vergleichbar ist: Während dieser bei ATI auf einen trilinearen Grundfilter inklusive einer doch schon anständig zu nennenden Gesamtqualität setzt, bekommt man bei nVidias G7x-Serie nur einen brilinearen Grundfilter samt mehrerer mittelschwerer bis gravierender Filter-"Optimierungen". Diese lassen sich zwar teilweise abschalten, aber dann passt natürlich die Performance wie auch die Bildqualität nicht mehr zum "Quality"-Modus, sondern es geht dann schon in Richtung des "High Quality" Modus.

Somit erscheint letztgenannter Modus auch als die einzig richtige Wahl, will man nVidia G7x-Grafikkarten mit der ATI-Bildqualität vergleichen – nVidias "High Quality" liegt zumindestens klar näher an ATIs Standard-Qualität als der nVidia-default-Modus "Quality". Für ATIs zusätzlichen Modus "Area-AF" hat nVidia wie schon erwähnt derzeit kein Äquivalent, hier liegt der Bildqualitäts-Vorteil dann eindeutig bei ATI.

Nicht verschwiegen werden soll allerdings, daß selbst in den jeweils höchsten Filter-Modi beide Hersteller immer noch diverse kleinere "Optimierungen" mitlaufen haben, welche selbst von den Anwendungsprogrammen nicht mehr deaktivierbar sind. Ironischerweise handelt es sich dabei um eigentlich eher geringfügige Optimierungen in Bezug auf die Auswirkungen bei Performance und Filterqualität – sprich, der Anwender gewinnt damit nur geringfügig an Performance, was letztlich keinen großen Sinn zumindestens bei HighEnd-Grafikkarten macht. Diesen wäre besser gedient, wenn ATI und nVidia in wenigstens einem Filter-Modus im Treiber wirklich alle "Optimierungen" abschalten und die technisch jeweils höchstmöglich machbare Filterqualität anbieten würden.

Beim aktuellen G80-Chip hat nVidia hingegen enorm zugelegt bei der Filterqualität und bietet nun bei der höchsten verfügbaren Einstellung auch die beste derzeit verfügbare Filterqualität – auch inklusive weitestgehender Winkelunabhängigkeit – an. Allerdings wird die default-Einstellung "Quality" des nVidia-Treibers weiterhin mit einem brilinearen Filter "garniert", was zumindestens den G80-Varianten wohl nicht gerecht wird:

nVidia wäre hier also allerhöchstens der kleine Vorwurf zu machen, warum man nicht gleich "High Quality" zum Standardfiltermodus zumindestens für die GeForce 8800 Serie erhoben hat. Aber dies wäre Haarspalterei – wer will, der kann mit minimalen Änderungen an den Treibereinstellungen zu einer herausragenden Filterqualität kommen, welche selbst den hohen Standard der ATI-Karten (geringfügig) zu überbieten in der Lage ist.

Testumgebung und -settings

Mit diesem Test kamen von unseren beiden Teststationen diesesmal nur das Intel-System zum Einsatz – zum zum einen, weil der dort benutzte Core 2 Duo Prozessor erst einmal schon eine deutlich höhere Pro/MHz-Leistung unter Spielen [48] aufweist und sich zum anderen auch deutlich besser übertakten lies. So wurden die Grafikkarten-Tests dieses Artikels dann auf 3200 MHz CPU-Takt durchgeführt, bei einem FSB1600 und einem Speichertakt von DDR2/800.

| Intel-Testsystem | |

|---|---|

| Prozessor | Intel Core 2 Duo E6400, Allendale-Core mit zwei Kernen (DualCore), 2133 MHz, Sockel 775, 2 MB Level2 Cache (shared), FSB1066 |

| benutzte Taktfrequenzen | für die eigentlichen Grafikkarten-Tests: 3200 MHz (8x400), FSB1600, DDR2/800 (Niveau ca. "E7000") für Vergleiche zur CPU-Limitierung: 2133 MHz (8x266), FSB1066, DDR2/533 (Niveau original E6400) |

| Mainboard | Asus P5W DH Deluxe, Sockel 775, Intel 975X + ICH7-R, unterstützt einzelne Grafikkarten mit 1x16 PCI Express Lanes und CrossFire mit 2x8 PCI Express Lanes |

| Speicher | 2x 1 GB OCZ "Platinum XTC Revision 2" DDR2/800, Ratings: 4-4-4-15 @ DDR2/800 |

| Soundkarte | Creative SoundBlaster Audigy2 ZS |

| Festplatte | Maxtor DiamondMax Plus 9, 160 GB, SATA1 |

| Laufwerke | MSI D16 DVD-Laufwerk |

| Netzteil | Tagan TG480-U01, nominell 480 Watt, 12-Volt-Leitung: 28A |

| Peripherie | an einem Monitor/Maus/Tastatur-Umschalter: Samsung Syncmaster 957p 19" Röhrenmonitor, maximale Auflösung: 2048x1536 + Logitech M-BE58 First / Pilot Wheel Mouse + No-name Keyboard |

| Software | Microsoft Windows XP Home, Service Pack 2 (inklusive DirectX 9.0c) |

| Grafikkarten | Sapphire Radeon X1900 XT 512MB @ XTX, 650/775 MHz, Catalyst 6.12 (A.I. low) Sapphire Radeon X1950 XTX 512MB, 650/1000 MHz, Catalyst 6.12 (A.I. low) nVidia GeForce 7900 GTX 512MB, 650/800 MHz, nVidia 93.71 ("High Quality") Asus GeForce 8800 GTX 512MB, 575/1350/900 MHz, nVidia 97.44 ("Quality") |

[49]

[49]Testsystem [49]

Bei der Radeon X1950 XTX wurde bezüglich der Filtersettings "A.I. low" (die default-Einstellung) gewählt, zusätzlich war zudem das bessere, weil weitestgehend winkelunabhängige Area-AF aktiv. Bei der GeForce 7900 GTX wurde bezüglich der Filtersettings "High Quality" unter Deaktivierung aller angebotenen Filter-"Optimierungen" gewählt. Bei der GeForce 8800 GTX wurde hingegen das Filtersetting "Quality" gewählt, weil diesen den Filterqualitäten der Vergleichskarten am nähesten kommt.

Als Testsettings wurden generell folgende Settings gewählt, welche die benutzten Grafikkarten sowohl nach unten (Radeon X1950 XTX und GeForce 7900 GTX) als auch nach oben (GeForce 8800 GTX) möglichst gut auslasten sollten:

- 1280x1024, 4x Anti-Aliasing, Adaptive/Transparenz Anti-Aliasing, 16x anisotroper Filter

- 1600x1200, 4x Anti-Aliasing, 16x anisotroper Filter

- 1600x1200, 4x Anti-Aliasing, Adaptive/Transparenz Anti-Aliasing, 16x anisotroper Filter

- 1920x1440, 16x anisotroper Filter

- 1920x1440, 4x Anti-Aliasing, 16x anisotroper Filter

- 1920x1440, 4x Anti-Aliasing, Adaptive/Transparenz Anti-Aliasing, 16x anisotroper Filter

Zusätzlich wurden noch extra Tests unter 1280x1024 mit den höheren Anti-Aliasing Modi 8x, 8xQ, 16x und 16xQ angestellt, um deren Leistungshunger einschätzen zu können. Weitere extra Tests beschäftigen sich mit dem Einfluß der Filtersettings auf die Radeon X1950 XTX (A.I. low vs. A.I. off) und GeForce 8800 GTX ("Quality" vs. "High Quality"). Zudem gibt es noch Vergleiche zur CPU-Limitierung, bei welchen die Auflösung auf 800x600 heruntergedreht und auf Anti-Aliasing wie anisotropen Filter verzichtet wurde, die Filtersettings der einzelnen Grafikkarten blieben aber auch dort identisch.

Bezüglich des Sounds wurden die Creative-Soundkarte üblicherweise mit maximaler Qualität und wenn möglich auf EAX 5.1 betrieben. In den Benchmark-Spielen selber wurde fast ausschließlich die maximal mögliche Bildqualität gewählt – mit den nachfolgend beschriebenen Ausnahmen:

- Anno 1701

Version: 1.01, Settings: alles auf maximum - Gothic 3

Version: 1.12, alles auf maximum - GTR 2

Version: 1.1.0.0, Settings: alles auf maximum bis auf: Schatten auf hoch & mittlere Scheinwerferdetails - Need for Speed: Carbon

Version: 1.3, Settings: alles auf maximum - Prey

Version: 1.2, Settings: alles auf maximum - The Elder Scrolls IV: Oblivion

Version: 1.5.11, Settings: alles auf maximum, aber kein HDR-Rendering (nur Blur)

Wie mittlerweile bei uns üblich, haben wir zur Performance-Ermittlung wieder auf Savegames anstatt auf Timedemos zurückgegriffen. Dies ermöglichte uns, auch aufgrund der Kürze der Savegames, speziell nur jene Szenen herauszusuchen, welche wir auch wirklich vermessen wollten – während bei einem Timedemo meistens mehrere Szenen (und viel Leerlauf) auf einmal vermessen werden, welche aber jeweils unterschiedliche Performance-Charakteristiken aufweisen können. Ein Timedemo-Durchlauf verwischt diese unterschiedlichen Szenen und deren unterschiedliche Performance-Charakteristik aber immer zu einer einzelnen Performance-Aussage, was die Aussagekraft einer solchen Messung dann doch erheblich einschränkt.

Anstatt Messungen des eher durchschnittlichen Gameflusses mittels Timedemos stellen unsere Messungen ausgewählter kurzer Szenen über den Weg der Savegames somit eher Worstcase-Benchmarks dar: Wir messen dann, wenn die Hardware wirklich unter Stress gerät – und eben auch nur die jeweilige Szene und nicht noch jede Menge Leerlauf oder gleich eine andere Szene mit hinzu. Konkret können wir sogar behaupten, daß die für die jeweiligen Test-Spiele von uns verwendeten Szenen mit zu den stressigsten des gesamten jeweiligen Spiels gehören und demzufolge sicherlich sehr realitätsnah sind.

Dies bezieht sich jedoch rein nur auf den Singleplayer-Part der jeweiligen Spiele. Denn der Multiplayer-Modus der meisten Spiele unterscheidet sich oft gravierend in Sachen Anzahl der im Einsatz befindlichen Einheiten und darzustellender Effekte, wodurch sich die CPU- und GPU-Last deutlich vom "üblichen" Singleplayer-Gameplay unterscheiden kann. Natürlich ist bekannt, daß im Multiplayer-Modus üblicherweise zuerst die CPU deutlich mehr belastet wird, dennoch wollen wir unsere Benchmark-Ergebnisse sicherheitshalber nur auf den Singleplayer-Modus der jeweiligen Spiele bezogen wissen.

Von den benutzten Savegames wurden jeweils immer die ersten drei bis fünf Sekunden zur Messung benutzt, welche dabei immer mittels Fraps [6] durchgeführt wurden. Dabei wurde jedes Savegame mehrfach ausgeführt wie gemessen und dann der Durchschnitt dieser Messungen als Ergebnis genommen. Die einzelnen Savegames wurden im übrigen nicht bewußt nach einer Grafikkarten- oder CPU-Limitierung ausgesucht, sondern es wurde nach ausgiebigem Spielen des jeweiligen Titels diese vier Szenen ausgewählt, welche uns am allgemeingültigsten und Hardware-fordernsten erschienen. Screenshots der verwendeten Savegames zur besseren Verdeutlichung der jeweils ausgemessenen Szene befinden sich dann in den einzelnen Benchmark-Kapiteln.

Benchmarks Anno 1701

Für Anno 1701 kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[50] [50]"Schloss" [50] |

[51] [51]"Stadt" [51] |

[52] [52]"Landgefecht" [52] |

[53] [53]"Seeschlacht" [53] |

Das erste Savegame "Seeschlacht" [53] stellt eine relativ stressige und damit möglichst allgemeingültige, aber dennoch realistische Schlachtszene dar:

Das zweite Savegame "Landgefecht" [52] stellt wiederum eine Schlachtszene dar, ist allerdings nochmals etwas stressender als das vorhergehende erste Savegame:

Das dritte Savegame "Stadt" [51] soll festhalten, was passiert, wenn man in einer größeren Stadt (hier waren es runde 3900 Einwohner) unterwegs ist, was schließlich auch an den Resourcen zehrt:

Das vierte und letzte Savegame "Schloss" [50] wurde nun im Gegensatz zu den drei vorhergehenden und eher stressigen Savegames bewußt "normal" gehalten, um einen Überblick über die Performance unter Anno 1701 in eher normalen Szenen zu erhalten:

In der Summe der Messungen unter Anno 1701 ergibt sich ein recht erstaunliches Bild: Während in dem eher genügsamen Savegame "Schloss" die GeForce 8800 GTX klarstens dominiert, zeigen die drei eher stressenden Savegames ein völlig anderes Bild, wo die GeForce 8800 GTX hart mit der Radeon X1950 XTX um die Spitzenposition ringen muß. Insofern sind wir an dieser Stelle durchaus glücklich, uns nicht nur auf eine Szene zur Performance-Wertung verlassen zu haben – dies hätte ein in gewissem Sinne falsches Urteil bedeuten können.

Denn nach Betrachtung der vier Savegames muß klar gesagt werden, daß der GeForce 8800 GTX die hervorragende Performance im Savegame "Schloss" eigentlich nicht wirklich weiterhilft, da es wirklich kaum eine Rolle spielt, ob man in einer schnellen Szene und in einem Spiel wie Anno 1701 nun 30 oder 60 fps hat. Relevanter sind sicherlich die drei eher stressigen Savegames – und hier patzt die GeForce 8800 GTX in gewissem Sinne, da man in diesen drei Savegames keinen wirklichen Unterschied zur Radeon X1950 XTX herausarbeiten kann.

Generell muß zudem zu Anno 1701 gesagt werden, daß das Spiel die Aktivierung von Transparenz Anti-Aliasing nach wie vor mit einem erheblichen Frameraten-Verlust bestraft, welches selbst durch eine solche absolute HighEnd-Karte wie die GeForce 8800 GTX nicht wirklich auszugleichen ist. In unseren Messungen kam deutlich heraus, daß nur in diesen Bildqualitäts-Settings ohne Transparenz Anti-Aliasing eine gute Spielbarkeit zu erreichen war. Dieser erhebliche Effekt von Transparenz Anti-Aliasing sollte aber eher an diesem Spiel liegen und kann somit nicht direkt auf andere Spiele übertragen werden.

Benchmarks Gothic 3

Für Gothic 3 kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[54] [54]"1. Tag (Nr.1)" [54] |

[55] [55]"1. Tag (Nr. 2)" [55] |

[56] [56]"18. Tag" [56] |

[57] [57]"34. Tag" [57] |

Das erste Savegame "1. Tag (Nr.1)" [54] stellt eine stressige, aber diesbezüglich noch nicht überzogene Szene mit vielen zu sehenden Kämpfern dar:

Das zweite Savegame "1. Tag (Nr.2)" [55] beinhaltet eine besonders für die Grafikkarten sehr schlauchende Szene:

Das dritte Savegame "18. Tag" [56] stellt eine eher normale Szene im Gelände dar:

Das vierte und letzte Savegame "34. Tag" [57] stellt dann noch eine eher normale Szene in der Stadt dar:

In der Summe der Messungen unter Gothic 3 (welches generell kein Anti-Aliasing unterstützt, was somit hier auch nicht getestet wurde) läßt sich nichts anderes als ein klarerVorsprung für die neuen nVidia Top-Karte erkennen, diese rennt den beiden früheren Top-Grafikkarten in jedem einzelnem Savegame mit weitem Abstand davon. Auffällig ist dabei, daß die Unterschiede gerade in den beiden eher langsamen Savegames um so größer sind: Hier liegt die GeForce 8800 GTX regelmäßig auf der doppelten bis teilweise zur dreifachen Leistung von Radeon X1950 XTX und GeForce 7900 GTX.

Interessanterweise erreicht die GeForce 8800 GTX damit in diesem Spiel etwas, was es so bisher noch nicht gegeben hatte: Spielbarkeit mit hohen Frameraten selbst bei hohen Auflösungen samt hohen Bildqualitäts-Settings. Während Radeon X1950 XTX und GeForce 7900 GTX so ihre lieben Probleme mit steigender Auflösung haben, liefert die GeForce 8800 GTX selbst unter sehr hohen 1920x1440 immer noch überall mindestens 30 fps ab.

Benchmarks GTR 2

Für GTR 2 kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[58] [58]"Spa am Tag" [58] |

[59] [59]"Spa am Tag mit Regen" [59] |

[60] [60]"Spa in der Nacht" [60] |

[61] [61]"Spa in der Nacht mit Regen" [61] |

Das erste Savegame "Spa am Tag" [58] stellt den Start eines Rennens mit einer ausreichenden Anzahl an CPU-gesteuerten Piloten am Tage dar:

Das zweite Savegame "Spa am Tag mit Regen" [59] stellt den Start eines Rennens mit einer ausreichenden Anzahl an CPU-gesteuerten Piloten am Tage, allerdings zusätzlich mit Regen, dar:

Das dritte Savegame "Spa in der Nacht" [60] stellt den Start eines Rennens mit einer ausreichenden Anzahl an CPU-gesteuerten Piloten in der Nacht dar:

Das vierte und letzte Savegame "Spa in der Nacht mit Regen" [61] stellt den Start eines Rennens mit einer ausreichenden Anzahl an CPU-gesteuerten Piloten in der Nacht, allerdings zusätzlich mit Regen, dar:

In der Summe der Messungen unter GTR 2 kann sich wiederum die GeForce 8800 GTX eindeutig an die Spitze setzen, auch wenn die Unterschiede hier nicht ganz so groß wie bei Gothic 3 sein mögen. Auffallend ist hier, daß im eher langsam laufenden Savegame "Spa am Tag mit Regen" die beiden früheren Top-Karten relativ nahe an die GeForce 8800 GTX heranrücken – auf der anderen Seite ergeben sich im anderen eher langsam laufenden Savegame "Spa in der Nacht mit Regen" wieder die gewohnten größeren Abstände.

Generall kann man auch für diese Messungen sagen, daß nur die GeForce 8800 GTX hier in den gewählten Auflösungen und Bildqualitätssettings wirklich die Power hat, (fast) überall vollkommen spielbare Frameraten von 30 fps garantieren zu können. Der Radeon X1950 XTX gelingt dies nur noch teilweise, während die GeForce 7900 GTX viel zu oft unterhalb die 20-fps-Grenze rutscht. Damit ergibt die Mehrleistung der GeForce 8800 GTX nicht nur schöner anzusehende Benchmark-Balken, sondern vor allem auch ein deutliches "Mehr" an Spielbarkeit in diesem Spiel.

Benchmarks Need for Speed: Carbon

Für Need for Speed: Carbon kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[62] [62]"Highway 142" [62] |

[63] [63]"Downtown" [63] |

[64] [64]"Million Dollar Run" [64] |

[65] [65]"Valley" [65] |

Das erste Savegame "Highway 142" [62] stellt den Start eines Rundenrennens mit elf Gegnern dar:

Das zweite Savegame "Downtown" [63] stellt wiederum den Start eines Rundenrennens mit elf Gegnern dar:

Das dritte Savegame "Million Dollar Run" [64] stellt den Start eines Radarfallenrennens mit sieben Gegnern dar:

Das vierte und letzte Savegame "Gold Valley" [65] stellt den Start eines Standardrennens mit drei Gegnern dar:

In der Summe der Messungen unter Need for Speed: Carbon zeigt sich ein zu den vorherigen Benchmarks unter GTR 2 nicht unähnliches Bild: Wiederum liegt die GeForce 8800 GTX überall und zudem mit recht konstantem Abstand vor. Auffällig ist aber, daß die Radeon X1950 XTX hier noch einigermaßen mithalten kann, während die GeForce 7900 GTX dann schon erheblich gegenüber der neuen Top-Karte von nVidia zurückhängt: Oftmals kommt die neuere Karte hier auf das Doppelte, manchmal bis zum Dreifachen der Frameraten der älteren Karte.

Auch hier läßt sich zudem wieder das Fazit ziehen, daß die GeForce 8800 GTX in viel mehr Fällen als die Radeon X1950 XTX (in einigen Fällen) oder die GeForce 7900 GTX (im Prinzip gar nicht mehr) problemlose Spielbarkeit garantieren kann. Allerdings geht der neuen Top-Karte von nVidia wenigstens unter dem höchsten gewählten Setting von 1920x1440 mit 4x Anti-Aliasing, Transparenz Anti-Aliasing und 16x anisotropen Filter etwas der Sprit aus – zumindestens wenn man unbedingt überall 30 fps sehen will. Radeon X1950 XTX und GeForce 7900 GTX hängen in diesem Setting dann aber schon meilenweit im klar unspielbarem Bereich zurück.

Benchmarks Prey

Für Prey kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[66] [66]"Facing the Enemy" [66] |

[67] [67]"Oath of Vengeance" [67] |

[68] [68]"Resolutions Nr.2" [68] |

[69] [69]"Resolutions Nr.1" [69] |

Das erste Savegame "Facing the Enemy" [66] stellt eine der wenigen wirklich Hardware-fordernden Szenen des Spiels dar:

Das zweite Savegame "Oath of Vengeance" [67] stellt ebenfalls eine der wenigen wirklich Hardware-fordernden Szenen des Spiels dar:

Das dritte Savegame "Resolutions Nr.1" [69] stellt eine weiteren der wenigen wirklich Hardware-fordernden Szenen des Spiels dar:

Das vierte und letzte Savegame "Resolutions Nr.2" [68] stellt nochmals eine der der wenigen wirklich Hardware-fordernden Szenen des Spiels dar. Ein Ausmessen normaler Szenen war in diesem Spiel nicht sinnvoll, da es sich doch recht genügsam bezüglich der Hardware-Anforderungen gibt:

In der Summe der Messungen unter Prey (welches durch die OpenGL-Schnittstelle kein Adaptive/Transparenz Anti-Aliasing unterstützt, was somit hier auch nicht getestet wurde) kann man wiederum einen sehr eindeutigen Benchmark-Sieg für die GeForce 8800 GTX konstatieren, selbst wenn das Spiel meistens auch auf den beiden früheren Top-Karten anständig läuft und somit hier nicht unbedingt deutlich mehr Performance nötig wäre für eine zufriedenstellende Spielbarkeit.

So sind den gerade die Benchmarks unter 1600x1200 eher gelassen zu sehen, garantieren hier doch auch Radeon X1950 XTX (vollständig) und GeForce 7900 GTX (mit einer kleinen Einschränkung) für Frameraten jenseits der 30-fps-Grenze. Unter der Auflösung von 1920x1440 fängt dann aber doch das Territorium der GeForce 8800 GTX an, da dort nur noch die Radeon X1950 XTX überall mindestens 25 fps bietet, die GeForce 7900 GTX dagegen schon in grenzwertige Frameraten absinkt. Mittels der GeForce 8800 GTX ist man hier mit überall mindestens 35 fps jederzeit auf der sicheren Seite.

Benchmarks The Elder Scrolls IV: Oblivion

Für The Elder Scrolls IV: Oblivion kamen die folgenden Savegames zum Einsatz (Klick öffnet jeweils einen Screenshot des Savegames im Großformat als extra Fenster):

[70] [70]"Das Herzland" [70] |

[71] [71]"Die Goldküste" [71] |

[72] [72]"Kaiserstadt" [72] |

[73] [73]"The West Weald" [73] |

Das erste Savegame "Das Herzland" [70] stellt eine stressige, aber ansonsten doch eher normale Szene im Gelände dar:

Das zweite Savegame "Die Goldküste" [71] beinhaltet eine speziell auf "WorstCase" getrimmte Schlachszene:

Das dritte Savegame "Kaiserstadt" [72] stellt wiederum eine stressige, aber ansonsten doch eher normale Szene im Gelände dar:

Das vierte und letzte Savegame "The West Weald" [73] stellt letztlich dann eine eher normale Szene im Gelände dar:

In der Summe der Messungen unter The Elder Scrolls IV: Oblivion ergibt sich ein etwas uneinheitliches Bild: Normalerweise liegt die GeForce 8800 GTX eigentlich vorn, gerade aber im allgemein langsamsten Savegame "Kaiserstadt" erreicht man faktisch nur die gleichen Werte wie die Radeon X1950 XTX. Allerdings scheint in diesem Fall wohl eine heftige CPU-Limitierung vorzuliegen, welche die GeForce 8800 GTX also wieder entlastet. Die drei anderen Savegames entscheidet die neue Top-Karte von nVidia dann jedoch wieder mit hohen Vorteilene gegenüber der Radeon X1950 XTX und teilweise dramatischen Vorteilen gegenüber der GeForce 7900 GTX für sich.

Auffallend ist auch bei diesem Spiel wieder, daß sich die GeForce 8800 GTX oftmals in den Vordergrund spielen kann als einzige Karte, welche unter einem bestimmten Setting noch für durchgehend hohe Frameraten garantieren kann. Radeon X1950 XTX und GeForce 7900 GTX gehen ziemlich schnell die Puste aus, diese Karten können nur bei den beiden niedrigsten Settings für Frameraten von über 20 fps garantieren (über das dritte Savegame mit der sehr hohen CPU-Limitierung im Fall der GeForce 7900 GTX einmal hinweggesehen).

Diese 20-fps-Grenze schafft die GeForce 8800 GTX hingegen bis auf die Messungen unter Transparenz Anti-Aliasing einzuhalten, auch hier ergibt sich also mit dieser Karte ein erheblicher Zugewinn an Spielbarkeit. Auffallend ist zudem noch, daß ähnlich den Messungen zu Anno 1701 die Grafikkarten doch erheblich bei der Zuschaltung von Adaptive/Transparenz Anti-Aliasing einbrechen – auch Oblivion scheint nicht für dieses Feature gemacht zu sein.

Vergleich der CPU-Lasten

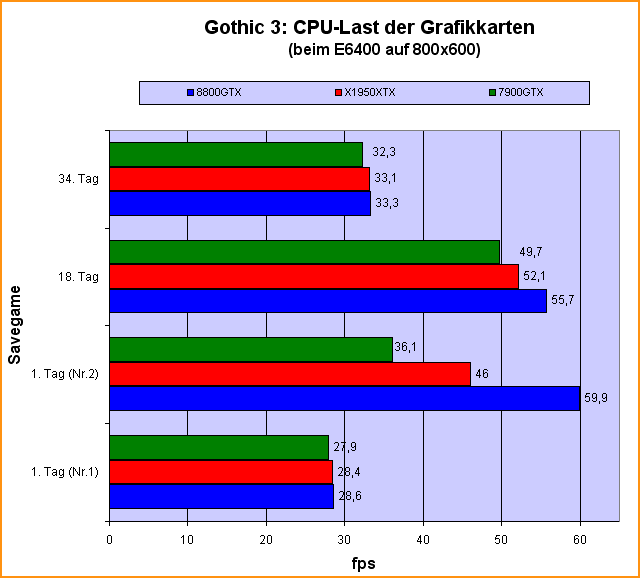

Mit den nachfolgenden Messungen gehen wir der Frage nach, ob die einzelnen benutzten Grafikkarten-Treiber eventuell eine unterschiedliche Höhe an CPU-Last erzeugen. Dazu wurden die bildqualitätsverbessernden Maßnahmen Anti-Aliasing und anisotroper Filter abgeschaltet und die Auflösung auf 800x600 gesenkt:

Bei diesen Tests ergaben sich nur selten Auffälligkeiten: Neben ein paar Ausreißern (größtenteils bedingt durch Grafikkarten-Limitierung) fällt eigentlich nur Need for Speed: Carbon auf, wo die ATI-Karte konstant eine niedrigere CPU-Last hinlegt als die beiden nVidia-Karten (wobei bei der GeForce 7900 GTX schon die Grafikkarten selber limitiert). Mit Mittel der unter allen Benchmark-Spielen angestellten Messungen ergeben sich hier aber dennoch keine wirklich beachtbaren Unterschiede.

Test der höheren Anti-Aliasing Modi

Mit den nachfolgenden Messungen soll überprüft werden, wie sich die höheren Anti-Aliasing Modi der GeForce 8800 GTX schlagen. Dazu wurden sowohl die normalen Anti-Aliasing Modi 4x und 8xQ sowie die abgespeckten "Coverage Anti-Aliasing" Modi 8x, 16x und 16xQ unter der Auflösung von 1280x1024 betrachtet. Zudem wurde Transparenz Anti-Aliasing (samt 16xAF) aktiviert, um den Anspruch von höchstmöglicher Bildqualität gerecht zu werden – allerdings mit der Ausnahme von Prey und Oblivion, dort war kein Transparenz Anti-Aliasing aktiv:

Zumindestens unter der gewählten Auflösung von 1280x1024 laufen die höheren Anti-Aliasing Modi noch erstaunlich gut mit, insbesondere die beiden Coverage Anti-Aliasing Modi mit einem nur 4x Multisampling-Anteil (8x und 16x). Anscheinend kann Coverage Anti-Aliasing hier seinem Anspruch gerecht werden und bietet einen vertragbaren Performanceverlust gegenüber den jeweiligen Multisampling-Ausgangsmodi. Dagegen erreichen die beiden Q-Modi, wo jeweils ein 8x Multisampling-Anteil dahintersteckt (8xQ und 16xQ) überall klar niedrigere Frameraten. Hierbei kommt es dann stark auf das jeweilige Spiel an, ob es noch zu durchgehend spielbaren Frameraten ausreicht.

Vergleich der verschiedenen Filter-Modi

Ein weiteres Kapitel gilt der Frage, inwiefern die unterschiedlichen Filtersettings der Grafikkartentreiber einen Einfluß auf die Performance haben. Hierzu wurde die GeForce 8800 GTX zusätzlich zum Standard-Test auf dem "Quality" Setting auch unter "High Quality" vermessen, die Radeon X1950 XTX zusätzlich zum Standard-Test auf dem "A.I. low" Setting auch unter "A.I. off". Zu beachten wäre bei letzterem, daß ATIs A.I. nicht nur Filterqualitäts-Settings enthält, sondern auch teilweise elementare Performance-Tweaks für einige Spiele, welche jedoch (gewöhnlich) nicht in die Bildqualität eingreifen:

Im Fall der GeForce 8800 GTX Filtermodi "Quality" gegen "High Quality" ergeben sich keine beachtbaren Performance-Unterschiede – faktisch kann man überall bedenkenlos "High Quality" aktivieren, ohne merkbar an Performance zu verlieren. Interessanterweise trifft diese Einschätzung bei der Radeon X1950 XTX und deren Vergleich "A.I. low" gegen "A.I. off" nicht zu: Hierbei ergaben sich doch hier und da bemerkenswerte Unterschiede, welche sich bei allgemein niedrigen Frameraten auch durchaus schon einmal in der Praxis bemerkbar machen könnten.

ATI Radeon X1900 XTX vs. Radeon X1950 XTX

Und letztlich wollen wir uns als kleinen Bonus noch der Frage nach dem Performance-Unterschied zwischen Radeon X1900 XTX und Radeon X1950 XTX widmen. Beide Karten basieren letztlich auf derselben Technik, einen Unterschied gibt es nur beim Speicher und dessen Takt: Während die Radeon X1900 XTX auf 512 MB GDDR3 mit 775 MHz Takt setzt, war die Radeon X1950 XTX die erste Karte mit GDDR4-Speicher – auf ihr sind 512 MB mit einer Taktraten von 1000 MHz verbaut:

Dies ergibt allerdings in der Summe der Messungen keine wirklich beachtbaren Unterschied. Einige der Benchmark-Spiele reagieren dabei auf den Speichertakt-Unterschied ganz annehmlich, andere hingegen so gut wie überhaupt nicht. Zudem ergibt sich der leise Verdacht, daß der Speichertakt-Unterschiede ausgerechnet bei den eher schneller laufenden Savegames mehr bringt, während es dort, wo man mehr Performance bräuchte, relativ gesehen weniger bringt.

Fazit

Bis auf einige Ausnahmen konnte die GeForce 8800 GTX erwartungsgemäß vollkommen überzeugen und legte einige sehr beeindruckende Performance-Zuwächse gegenüber Radeon X1950 XTX und GeForce 7900 GTX aufs Parkett. Um dies noch einmal genauer zu rekapitulieren, gibt die folgende Tabelle Auskunft über die Essenz unserer vorangegangenen Benchmarks. Die Formulierung "klar nicht spielbar" ergibt sich hierbei, wenn ein einzelnes der Savegames nicht mehr als 10 fps erreicht, "eingeschränkt spielbar" steht gewöhnlich für Frameraten von 15 bis 20 fps und für "problemlos spielbar" sollten es eigentlich überall 25 fps oder mehr sein. In jenen Fällen, die zwischen diesen Regeln liegen, wurde dann nach Abwägung aller vier Savegames entschieden:

| Spiel | Setting | Spielbarkeit mit GeForce 8800 GTX | Spielbarkeit mit Radeon X1950 XTX | Spielbarkeit mit GeForce 7900 GTX |

|---|---|---|---|---|

| Anno 1701 | 1280x1024, 4xAA + TAA, 16xAF | eingeschränkt spielbar | eingeschränkt spielbar | klar nicht spielbar |

| 1600x1200, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1600x1200, 4xAA + TAA 16xAF | eingeschränkt spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1920x1440, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1920x1440, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1920x1440, 4xAA + TAA, 16xAF | eingeschränkt spielbar | klar nicht spielbar | klar nicht spielbar | |

| Gothic 3 | 1280x1024, 16xAF | problemlos spielbar | eingeschränkt spielbar | eingeschränkt spielbar |

| 1600x1200, 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1920x1440, 16xAF | problemlos spielbar | klar nicht spielbar | klar nicht spielbar | |

| GTR 2 | 1280x1024, 4xAA + TAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar |

| 1600x1200, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1600x1200, 4xAA + TAA 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1920x1440, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1920x1440, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1920x1440, 4xAA + TAA, 16xAF | problemlos spielbar | eingeschränkt spielbar | eingeschränkt spielbar | |

| NfS: Carbon | 1280x1024, 4xAA + TAA, 16xAF | problemlos spielbar | eingeschränkt spielbar | eingeschränkt spielbar |

| 1600x1200, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| 1600x1200, 4xAA + TAA 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1920x1440, 16xAF | problemlos spielbar | problemlos spielbar | klar nicht spielbar | |

| 1920x1440, 4xAA, 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1920x1440, 4xAA + TAA, 16xAF | eingeschränkt spielbar | klar nicht spielbar | klar nicht spielbar | |

| Prey | 1280x1024, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | problemlos spielbar |

| 1600x1200, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | problemlos spielbar | |

| 1920x1440, 16xAF | problemlos spielbar | problemlos spielbar | problemlos spielbar | |

| 1920x1440, 4xAA, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar | |

| TES4: Oblivion | 1280x1024, 16xAF | problemlos spielbar | problemlos spielbar | eingeschränkt spielbar |

| 1280x1024, 4xAA, 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1280x1024, 4xAA + TAA, 16xAF | klar nicht spielbar | klar nicht spielbar | klar nicht spielbar | |

| 1600x1200, 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar | |

| 1600x1200, 4xAA, 16xAF | problemlos spielbar | eingeschränkt spielbar | klar nicht spielbar |

Gerade gegenüber der GeForce 7900 GTX positioniert sich die GeForce 8800 GTX herausragend – die alte Top-Karte von nVidia ist unter heutigen Spielen mit den von uns gewählten hohen Settings kaum noch in der Lage, problemlos spielbare Frameraten abzuliefern, währenddessen die GeForce 8800 GTX ganz umgedreht fast überall im völlig grünen Bereich liegt. Die Radeon X1950 XTX für ihren Teil kann hier und da noch gut punkten, liegt in der Summe aber dennoch ebenfalls klar gegenüber dem aktuellen Top-Modell von nVidia zurück.

Dabei stellen vorstehende Spielbarkeits-Einschätzungen auch wieder nur die Hälfte der Wahrheit dar: Oftmals erreicht die Radeon X1950 XTX in den von uns ausgewählten neueren Spielen nur recht knapp den problemlos spielbaren Bereich, währenddessen die GeForce 8800 GTX fast überall noch große Framerate-Reserven hat. Im Mittel kann man von einem Vorsprung der GeForce 8800 GTX vor der Radeon X1950 XTX von 60 bis 70 Prozent sprechen. Natürlich muß es in den aktuellen Spielen nicht schneller als "flüssig" sein, allerdings dürften diese Reserven natürlich gerade bei zukünftigen, noch mehr Hardware-fordernden Spielen zugunsten der GeForce 8800 GTX anschlagen.

Letztendlich hat nVidia damit bei der GeForce 8800 GTX alles richtig gemacht: Direct3D10-Featureset, verbesserte Bildqualitäts-Features und überall ausreichende Performance mit Reserven für die Zukunft ergeben ein sehr rundes Paket – selten konnte eine HighEnd-Grafikkarte dermaßen ihr Segment (und inzwischen auch noch über diesen Zeitraum) dominieren. Demzufolge wird es um so spannender, was ATI nun mit der bald anstehenden Radeon HD 2900 Serie entgegensetzen kann bzw. was nVidia mit der wohl nur höher getakteten GeForce 8800 Ultra nachlegen kann.

Links zu weiteren Tests

Asus

- Asus EN8800GTX AquaTank (e) [74] [Bjorn3D]

- Asus EN8800 GTX (e) [75] [HardOCP]

- Asus EN8800GTX GeForce 8800 GTX (e) [76] [Hot Hardware]

- Asus EN8800GTX AquaTank/HTDP/ 768M Review (e) [77] [Overclockers Workbench]

BFG

- BFGTech 8800 GTX Watercooled Edition (e) [78] [Bit-Tech]

- BFG GeForce 8800 GTX Water Cooled (SLI) (e) [79] [Guru3D]

- BFGTech GeForce 8800 GTX Water Cooled Edition (e) [80] [HardOCP]

- BFG GeForce 8800GTX Grafikkarte (d) [81] [PC-Experience]

- BFG nVidia 8800 GTX OC Review (d) [82] [Technic3D]

eVGA

- eVGA e-GeForce 8800 GTX (e) [83] [Barry's Rigs 'n Reviews]

- eVGA e-GeForce 8800GTX KO ACS3 768MB (e) [84] [techPowerUp!]

Focxonn

- Foxconn GeForce 8800 GTX Review (e) [85] [AMDZone]

- Foxconn 8800 GTX Graphics Card (e) [86] [Bjorn3D]

- Foxconn GeForce 8800 GTX (e) [87] [Gaming Nexus]

- Foxconn GeForce 8800 GTX (d) [88] [HardwareOC]

- Foxconn GeForce 8800 GTX (e) [89] [Hot Hardware]

- Foxconn 8800GTX (e) [90] [XSreviews]

Gainward

- Gainward Bliss 8800 GTX im Test (d) [91] [Technic3D]

- Gainward 8800GTX (e) [92] [XSreviews]

MSI

- MSI GeForce 8800 GTX (NX8800GTX-T2D768E) (e) [93] [Hot Hardware]

- MSI NX8800GTX Review and Mixed-Vendor SLI (e) [94] [nV News]

- MSI NX8800GTX-T2D768E-HD Geforce 8800GTX PCI Express Videocard Review (e) [95] [PC Stats]

- MSI 8800GTX SLI (e) [96] [t-break]

- MSI 8800GTX OC Liquid (e) [97] [XSreviews]

- Gainward 8800GTX (e) [92] [XSreviews]

OCZ

- OCZ returns to Graphics Card Business with 8800 GTX (e) [98] [MadShrimps]

- OCZ Technology GeForce 8800 GTX 768 MB Video Card (e) [99] [OverClock Intelligence Agency]

Sparkle

- Sparkle Calibre 8800GTX P880+OC (e) [100] [Bjorn3D]

- Sparkle Calibre 8800 GTX 768MB OC Edition (e) [101] [MKVTech]

XFX

- XFX GeForce 8800 GTX XXX Edition Review (e) [102] [AMDZone]

- XFX 8800 GTX XXX (e) [103] [Bjorn3D]

- XFX GeForce 8800 GTX XXX Edition Review (e) [104] [Guru3D]

- XFX GeForce 8800 GTX 768MB DDR3 XXX Edition (e) [105] [Hexus]

- XFX 8800 GTX XXX Edition Graphics Card Review (e) [106] [Legit Reviews]

- XFX GF 8800GTX XXX Overclocked Video Card Review (e) [107] [Motherboards]

- XFX GeForce 8800GTX XXX Review (e) [108] [Neoseeker]

- XFX GeForce 8800 GTX XXX Edition Review – Overclocked Speed (e) [109] [PC Perspective]

- XFX nVidia 8800 GTX XXX Review (d) [110] [Technic3D]